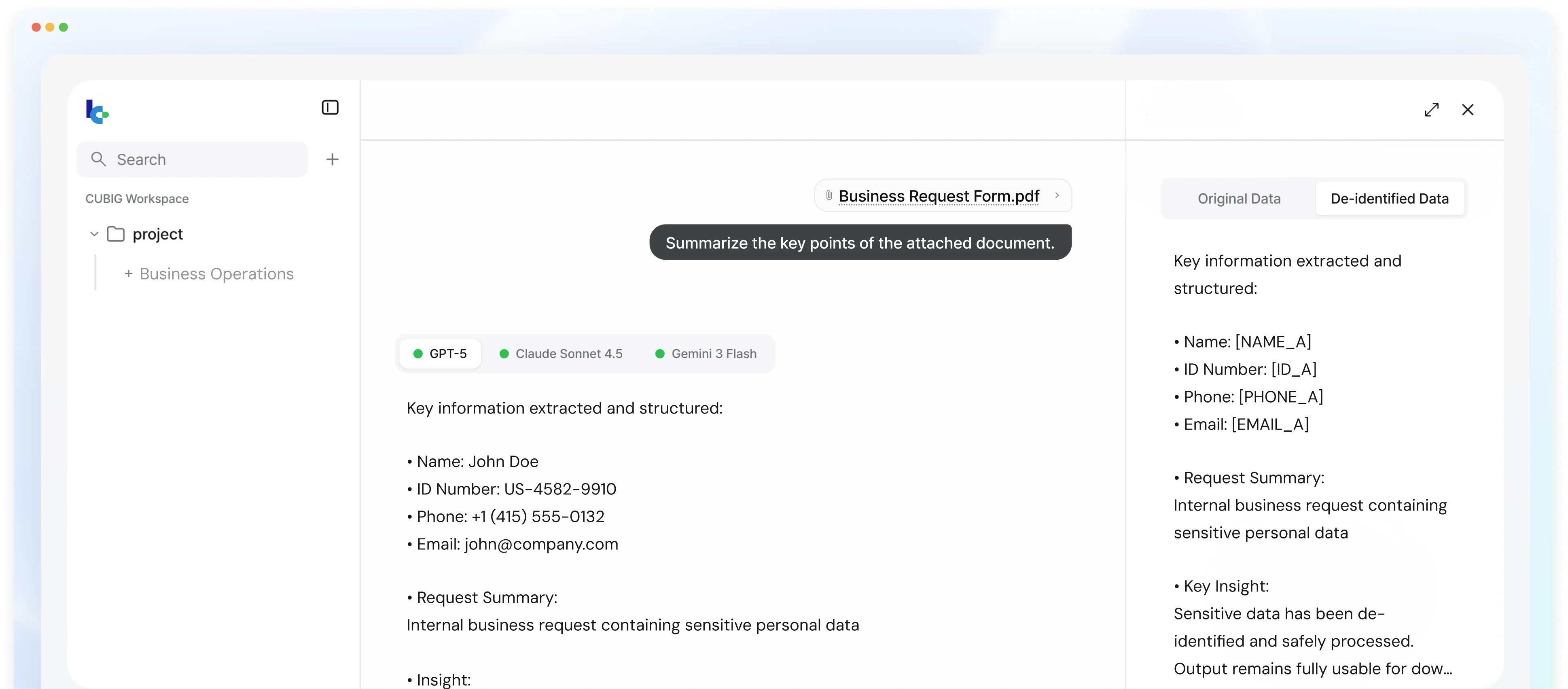

KI für sensible Dokumente – ohne Offenlegung vertraulicher Daten

Sensible Dokumente durchlaufen LLM Capsule, bevor sie an ein KI-Modell gesendet werden. Vertrauliche Namen, Kennzahlen und Fachbegriffe werden lokal durch sichere Platzhalter ersetzt. Die KI verarbeitet die geschützte Version. Anschliessend werden die Ergebnisse automatisch mit den Originaldaten angereichert. Ihre Organisation legt selbst fest, welche Inhalte als vertraulich gelten.

Im Einsatz bei Unternehmen mit hohen Anforderungen an den Dokumentenschutz

in den Bereichen Finanzen, Versicherung, Recht, Gesundheitswesen und Telekommunikation

Information Security Fast Track

Information Security Fast Track

GS Certification

GS Certification

ISO/IEC 27001

ISO/IEC 27001

ISO/IEC 42001

ISO/IEC 42001

Security Innovation Award

Security Innovation Award

Startup World Cup

Startup World Cup

Next Rise Global Innovator

Next Rise Global Innovator

T Challenge 2026

T Challenge 2026

AI Medical Innovation

AI Medical Innovation

Emerging AI+X Top 100

Emerging AI+X Top 100

Gartner Vendor

Gartner Vendor

Information Security Fast Track

Information Security Fast Track

GS Certification

GS Certification

ISO/IEC 27001

ISO/IEC 27001

ISO/IEC 42001

ISO/IEC 42001

Security Innovation Award

Security Innovation Award

Startup World Cup

Startup World Cup

Next Rise Global Innovator

Next Rise Global Innovator

T Challenge 2026

T Challenge 2026

AI Medical Innovation

AI Medical Innovation

Emerging AI+X Top 100

Emerging AI+X Top 100

Gartner Vendor

Gartner Vendor

Fünf Funktionen für den produktiven KI-Einsatz im Unternehmen

Bisherige Werkzeuge blockieren entweder die KI-Nutzung oder zerstören den Dokumentenkontext. LLM Capsule löst beide Probleme.

Keine Offenlegung sensibler Daten

Die KI erhält ausschliesslich sichere Platzhalter. Selbst wenn der LLM-Anbieter sämtliche Anfragen protokolliert, gelangen keine vertraulichen Unternehmensdaten nach aussen.

Fachlich nutzbare Ergebnisse

Die KI-Ergebnisse werden automatisch mit Originalnamen, Kennzahlen und Verweisen angereichert. Die Ausgaben sind direkt in Berichten, Rechtsgutachten und Kundenvorlagen einsetzbar. Eine manuelle Nachbearbeitung entfällt.

Individuelle Vertraulichkeitsregeln

Standardkategorien für personenbezogene Daten reichen nicht aus. Definieren Sie Projektcodes, Vertragsbedingungen, interne Kennungen und beliebige geschäftsspezifische Vertraulichkeitsmerkmale – abgestimmt auf Ihre Organisation.

Dokumentstruktur bleibt erhalten

Tabellen, Querverweise und Layouts bleiben während der Verarbeitung vollständig intakt. Die KI erfasst den gesamten Dokumentenkontext und arbeitet nicht mit unbrauchbaren Fragmenten.

Betrieb in bestehender IT-Umgebung

ChatGPT, Claude oder ein On-Premise-Modell – wechseln Sie jederzeit ohne Umbau und ohne Anbieterbindung. Der Schutz bleibt über alle Modelle hinweg konsistent.

KI-Einsatz in regulierten Branchen, in denen vertrauliche Daten bisher den Fortschritt blockiert haben

LLM Capsule ermöglicht die Verarbeitung realer Unternehmensdokumente mit KI – in Finanzdienstleistungen, Behörden, Gesundheitswesen und Rechtsabteilungen. Bisher blockierte Projekte gelangen so in den Produktivbetrieb.

KI-Einsatz im Unternehmen durch eine 3+2-Architektur

LLM Capsule basiert auf einer 3+2-Datenschicht-Architektur: drei Kernsäulen für den sicheren KI-Einsatz plus zwei ergänzende Funktionen für Ergebnisqualität und Modellflexibilität.

Zero Exposure

Sensible Daten werden innerhalb Ihrer Umgebung durch sichere Platzhalter ersetzt (Kapsulierung), bevor Informationen das Unternehmen verlassen. Originalwerte erreichen zu keinem Zeitpunkt externe KI-Dienste.

Zero Exposure bedeutet: Der KI-Anbieter verarbeitet nützliche Daten, kann aber keine sensiblen Originalwerte rekonstruieren. Selbst bei Protokollierung, Speicherung oder Verwendung als Trainingsdaten bleiben die ursprünglichen Unternehmensinformationen geschützt. Die geschützte Datenrepräsentation ist für die KI vollständig verarbeitbar, für den empfangenden Dienst jedoch nicht entschlüsselbar. Rohdaten verlassen das Unternehmen nicht.

KI-gestützte Unternehmensabläufe

LLM Capsule lässt sich in gängige KI-Workflows integrieren. Von der Dokumentenaufnahme bis zur Ergebnisausgabe ermöglicht eine einzige Datenschicht die KI-Verarbeitung realer Geschäftsdokumente.

Geschützte Dokumentenzusammenfassung

KI erstellt Management-Zusammenfassungen sensibler Dokumente – Verträge, Berichte, Anträge. Alle vertraulichen Elemente werden dabei durch sichere Platzhalter ersetzt. Die wiederhergestellten Zusammenfassungen enthalten echte Namen, Daten und Kennzahlen.

- Verträge, Berichte und Anträge geschützt

- Echte Namen, Daten und Kennzahlen in der Ausgabe wiederhergestellt

KI-gestützte Schadenbearbeitung

Versicherungs- und Finanzansprüche durchlaufen LLM Capsule vor der KI-gestützten Klassifizierung, Schadenbewertung und Betrugserkennung. Die angereicherten Ergebnisse fliessen direkt in Schadenmanagementsysteme ein – mit echten Versicherungsnehmerdaten.

- Klassifizierung, Schadenbewertung und Betrugserkennung ermöglicht

- Ergebnisse fliessen direkt in Schadensysteme ein

Vertrauliche Vertragsprüfung

KI extrahiert Schlüsselbegriffe, Verpflichtungen und Risikoklauseln aus geschützten Verträgen. Die wiederhergestellten Ergebnisse enthalten echte Parteinamen, Beträge und Klauselverweise – bereit zur Integration in Transaktionsmanagementsysteme.

- Schlüsselbegriffe, Verpflichtungen und Risikoklauseln extrahiert

- Echte Parteinamen, Beträge und Verweise wiederhergestellt

Interne Berichterstellung

KI erstellt interne Berichte aus geschützten Datenquellen: Leistungsbewertungen, Prüfungsergebnisse und Compliance-Zusammenfassungen. Die wiederhergestellten Berichte enthalten echte Mitarbeiternamen, Abteilungsdaten und Messwerte.

- Leistungsbewertungen, Prüfungsergebnisse, Compliance-Zusammenfassungen

- Echte Mitarbeiternamen, Abteilungsdaten und Messwerte wiederhergestellt

Unternehmensdaten sind nicht ohne Weiteres KI-fähig

Jedes Unternehmensdokument enthält vertrauliche Informationen, die nicht an externe KI-Modelle gesendet werden dürfen. Ohne reale Daten liefert KI jedoch nur generische, nicht verwertbare Ergebnisse. Darin liegt das zentrale Hindernis für den KI-Einsatz im Unternehmen.

- Ohne eine vorgeschaltete Schutzschicht können Unternehmen KI-Potenziale nicht ausschöpfen.

- Herkömmliche Ansätze – Maskierung, Schwärzung, Tokenisierung und Prompt-Security-Gateways – wurden nicht für KI-Workflows entwickelt. Maskierung und Schwärzung entfernen dauerhaft den Kontext, den KI-Modelle benötigen. Prompt-Gateways filtern auf API-Ebene, können aber Unternehmensdokumente nicht durchgängig verarbeiten.

- So entsteht ein grundlegendes Adoptionshindernis: Ohne eine Datenschicht, die sensible Daten KI-fähig macht und gleichzeitig schützt, bleiben KI-Projekte in der Pilotphase stecken.

| Ansatz | Methode | Einschränkung | Auswirkung auf KI-Workflows |

|---|---|---|---|

| Maskierung und Schwärzung | Dauerhafte Entfernung von Daten | Zerstört den für KI notwendigen Kontext | Unbrauchbare [REDACTED]-Ausgaben, die manuelle Rekonstruktion erfordern |

| Prompt-Security-Gateways | Prompt-Filterung auf API-Ebene | Kein Schutz auf Dokumentebene | Keine Wiederherstellungsfunktion für Ergebnisse |

| Plattformen für synthetische Daten | Erzeugung künstlicher Daten | Nur für Training und Tests geeignet | Kann reale Dokumente in produktiven KI-Workflows nicht ersetzen |

| Sicherheitsabteilung blockiert KI | Manueller Freigabeprozess | Blockiert sämtliche KI-Projekte | Projekte werden eingestellt, bevor sie ihren Nutzen belegen können |

Von blockierten KI-Projekten zu produktiven KI-Workflows mit verwertbaren Ergebnissen

KI im Unternehmen ist blockiert oder wirkungslos

- KI vollständig blockiert – Sicherheitsabteilungen lehnen Vorhaben wegen des Risikos einer Datenoffenlegung ab

- Maskierung und Schwärzung entfernen den Kontext – KI-Ergebnisse sind abstrahiert und in Unternehmensabläufen nicht einsetzbar

- Manuelle Prüfprozesse bleiben bestehen – Dokumente müssen von Hand bearbeitet werden, da KI keinen Zugang zu den echten Daten erhält

- Dokumentstruktur zerstört – pauschale Maskierung beschädigt Tabellen, Entitätsbeziehungen und Querverweise

- Minderwertige KI-Ergebnisse – selbst bei erlaubtem KI-Einsatz ist umfangreiche manuelle Nacharbeit nötig

- KI-Projekte bleiben in der Pilotphase stecken – kein Weg vom Proof of Concept in den Produktivbetrieb

KI-Einsatz auf Basis realer Unternehmensdaten

- KI für sensible Dokumente – die Datenschicht übernimmt den Schutz, damit sich Fachabteilungen auf die KI-Ergebnisse konzentrieren können

- Reale Dokumente werden mit führenden LLMs verarbeitet – ChatGPT, Claude, Gemini, Perplexity oder jede beliebige LLM-API

- Regulatorische Konformität erfüllt – die Zero-Exposure-Architektur genügt den KI-Governance-Anforderungen automatisch

- Wiederhergestellte Ergebnisse behalten den Geschäftskontext – echte Namen, Kennzahlen und Verweise werden lokal zurückgeführt

- Tabellen, Layouts, Querverweise und Dokumenthierarchie bleiben durch strukturerhaltende Verarbeitung vollständig erhalten

- 98 % Ergebnisübereinstimmung bei Zero Exposure – gemessen an realen Dokumentenverarbeitungs-Workloads

Eine Datenschicht zwischen Ihrem Unternehmen und jedem LLM

LLM Capsule befindet sich zwischen Ihren internen Systemen und externen KI-Modellen. Rohdaten verbleiben in Ihrer Umgebung. Die Vertrauensgrenze wird zu keinem Zeitpunkt durch Originaldaten überschritten. Die KI verarbeitet ausschliesslich die geschützte Version.

Gemessene Leistungswerte aus realen Dokumentenverarbeitungs-Workloads

Diese Messwerte basieren auf Unternehmensdokumenten mit durchschnittlich über 2.200 Zeichen in regulierten Branchen-Workflows, darunter Finanzwesen, Gesundheitswesen, Recht und öffentlicher Sektor.

Häufig gestellte Fragen

LLM Capsule kapsuliert sensible Daten lokal, bevor sie die Unternehmensumgebung verlassen. An KI-Modelle werden ausschliesslich geschützte Repräsentationen gesendet. Nach der Verarbeitung werden die Ergebnisse lokal wiederhergestellt und sind direkt in Unternehmensabläufen nutzbar. Die Originaldaten gelangen zu keinem Zeitpunkt zu externen KI-Diensten. Damit unterscheidet sich LLM Capsule grundlegend von reinen Überwachungs- oder Filterwerkzeugen.

Erfahren Sie, wie LLM Capsule KI auf Ihren Unternehmensdokumenten ermöglicht

Wir analysieren Ihre Anforderungen und demonstrieren LLM Capsule anhand Ihrer eigenen Daten, in Ihrer Umgebung und unter Berücksichtigung Ihrer Compliance-Vorgaben – einschliesslich DSGVO (GDPR), BSI C5 und branchenspezifischer Regularien.